人工知能時代の音声処理技術

■目覚ましい進歩を遂げてきた音声処理技術

音声認識技術は、最近ではすっかり身近なものとなり、「OK, Google, 音楽をかけて」「アレクサ、明日の天気は?」といったセリフが、日常的に聞かれるようになってきました。こうした製品の普及には、なんといっても音声認識そのものの正確性が格段に向上したことが寄与しているのですが、それ以外にも、スマートフォンの普及により、GoogleやAmazonなどの超高性能サーバーに、誰でも簡単にアクセスできるようになったことも大きいです。実際、そうしたサーバーには、皆さんが音声認識のために話した声のデータがすべて蓄積されており、それらのデータを使って、今も音声認識の性能向上のための作業が続けられているわけです。それに加えて、ここ十年ほどで目覚ましい進歩を遂げた深層学習(ディープラーニング)の技術が、現在の音声認識システムの高い性能を支えています。

コンピュータで音声を扱う技術としては、音声合成の性能もずいぶん良くなりました。20世紀のSF映画では、未来のコンピュータが話す声は、いかにも機械っぽい声というのが定番でしたが、実際には、人間が話しているのと区別がつかないような合成音声ができるようになってきています。最近では「ディープフェイク」などと言われる技術で、実在の人物のふりをした合成音声での詐欺なども行われていると聞きます。

技術の進化が時に負の側面を見せることは間々ありますが、さらにそれを見破るための研究も行われているようです。また、音声合成技術から派生した歌声合成技術も見逃せません。「ボカロ」は、今では音楽の一分野として認められるまでになりました。

■インターネットと深層学習が、音声認識を劇的に変えた

メディア学部が発足した1999年は、90年代前半に注目された人工知能技術がバブル崩壊とともに下火になり、音声研究も進むべき方向を模索しながら苦しんでいる状況でした。その頃から、隠れマルコフモデルと呼ばれる機械学習手法は用いられていたのですが、学習に用いるデータが十分に集められず、学習アルゴリズムも今のものに比べて不十分だったために、誤認識が頻繁に起こっていました。それでも、車の運転中は、カーナビを手で操作することが難しいので、音声認識機能を持った製品が数多く発売されたのですが、「ぜんぜん認識してくれない」というクレームに、開発者はいつも悩まされていました。

最初の転機は、高速なインターネット回線の普及でした。それまでの音声認識機能搭載製品は、いわゆる「売り切り」であり、製品の中にソフトをすべて入れておく必要があったのですが、インターネット回線の普及により、サーバーで音声認識を行うことが可能になったのです。これには2つの大きなメリットがありました。ひとつは、CPUの処理性能を気にする必要がなくなったこと。サーバー方式であれば、巨大なハードウェアに最新のCPUを搭載して対応することができるので、応答速度のために処理の緻密さを犠牲にする必要がありません。そしてもうひとつは、ユーザーの発声データのログが蓄積されていくこと。機械学習技術は使用できるデータの量が鍵ですから、データが無尽蔵に増えていくことは、何よりの性能向上要因でした。

インターネットの世界では、検索サービスが広く普及したことも役立ちました。大量の検索クエリのデータを分析することにより、ユーザーがどんな言葉を入力したいのかが予測できるようになったのです。こうした予測に用いるモデルを言語モデルと呼びますが、正確な言語モデルができたことにより、音声認識の性能は大きく向上しました。

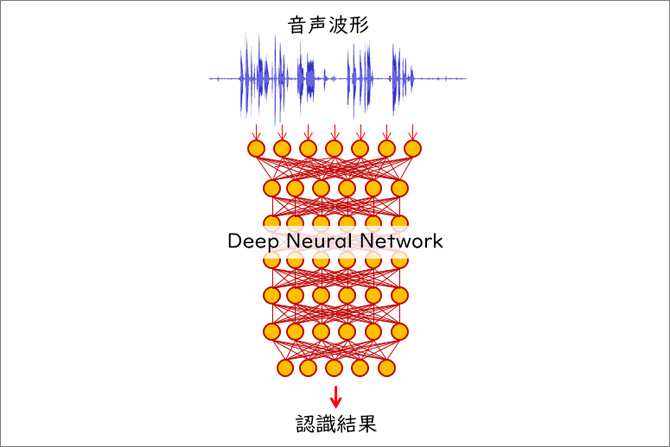

そして、性能向上の最後のピースとなったのが、深層学習技術の発展でした。深層学習で用いられるニューラルネットワークという仕組みは、人間の脳細胞を模倣した情報処理の仕組みとして、1990年代前半の人工知能ブームのときにも注目されたのですが、期待されたほどの性能が出ず、徐々に人気を失っていました。しかし、2010年代に入って、このニューラルネットワークを多層化し、声の波形から音素を推定する技術が開発されたのです。ちょうど同じ頃、画像の情報から写っているものを推定する技術としても深層学習が用いられ、これらの分野における成功から、世界中で人工知能ブームが起きました。

現在では、声から音素を推定する以外にも、多様な音からさまざまな情報を推定するために、この深層学習の仕組みが使えることがわかってきて、音研究の世界は右を見ても左を見ても深層学習だらけという状況です。そして、深層学習を活用する時代になって、学習用のデータを集めることの重要性がさらに増し、データを持つ者が世界を制するとまで言われるようになってきています。

■これからは研究者のセンスや美的感覚も重要に

人工知能が発展していく時代では、データの選別が成功の鍵になると言われています。実は、音声認識というのはそういう意味では特異な分野で、声を聞いて「何と言っているか」のラベルを付けることは、人間にとっては極めて簡単なことです。そのため、正しいデータを準備することの難しさに気づきにくかったのですが、それ以外の分野では、正しいデータを準備することは、それほど簡単ではありません。例えば、近年注目度が高まっている音声からの感情認識では、集めた声のデータに対し、「怒っている」「嬉しそう」「悲しそう」などのラベルを付ける必要があるのですが、これは人間にとっても簡単なことではありません。また、人間の感情を分析するのに、「怒り」「喜び」「悲しみ」などのラベルが本当に適切なものなのかというのも、実際のところ確かではありません。そこで、データをどのような観点で分類し、どのような方法で正しいラベルを付けていくのか、そういうところに研究者のセンスが問われるようになっていくわけです。

そのような特性もあって、これまでの人工知能技術は、正否がはっきりしたものに適用されてきました。しかし、これからの未来では、正否がはっきりしないものに対して人工知能をどう活用するかというのが、大きなテーマとなってきます。その代表例がアートでしょう。例えば、良い音楽のデータを集めて、人工知能による自動作曲や自動演奏を行うといった研究は、これからもっと盛んになっていくと思います。そのとき、何が良い音楽なのかというのは、人間の主観に左右されることです。こうした研究を行うためには、良質のコンテンツを選び取ることができる美的感覚と、人工知能の特性を理解する科学的知識とを併せ持っていることが不可欠になるでしょう。

■高校生の皆さんへ

メディア学部では、人工知能が普及していく時代に向けて、そこで用いられる機械学習やデータ処理の知識と、意味のあるコンテンツを吟味し制作するための知識、そしてそれらを社会の中でどう役立てていくかを考えるための知識とを学べるようなカリキュラムを用意しています。「人工知能が人間の仕事を奪う」などと言われる昨今ですが、人工知能に奪われない職業に就けるようになるためにも、メディア学の勉強を通じて得られる技術と感性とを、役立てていただければと思います。

このWebページでは、メディア技術コースの大淵先生にお話をうかがいました。

教員プロフィール

メディア技術コース 大淵 康成 教授

■日立製作所でカーナビやスマートフォン向けの音声認識・音声分析方式の研究に携わった後、2015年東京工科大学メディア学部に着任。それまで音声を対象に培ってきた技術を、音楽や日常生活音などに適用する研究、特に大量のデータから自動的に法則性を導き出す機械学習技術の応用研究に力を注ぐ。さらに、機械学習技術を使ったシンセサイザーや音楽パフォーマンスの分野にも研究対象を広げ、学生とともにさまざまな技術・システムの開発研究を進めている。

「私は企業の研究所で音に関する研究を始め、最初は声で操作できるカーナビなどを作っていました。その後、スマートフォン向け音声認識や、今でいうスマートスピーカーのようなものも扱っていましたが、なかなか製品化に結びつかず苦労しました。また、声と雑音を分離する技術や、声から感情を推定する技術など、さまざまな音声分析方式の研究にも取り組みました。本学に着任してからは、それまでに培ってきた技術を、音楽や日常生活音などにも適用したシステムを作っています。さらに、機械学習技術を使った音楽パフォーマンスの研究でも、大学院生と協力して面白いものを作れるようになってきました。」